Unternehmen erkennen KI als Wettbewerbsvorteil, und die Anwendungsfälle nehmen rasant zu. Leistungsstarke GPUs haben die Fantasie und die Investitionen im Wettlauf um die immer schnellere Verarbeitung enormer Datenmengen beflügelt. Die Technologie ist sensationell, aber was ist mit der übrigen Hardware, die KI-Computing überhaupt erst ermöglicht?

Wenn die Rechenleistung das Gehirn der digitalen Welt ist, dann ist die Vernetzung das zentrale Nervensystem – und dieses durchläuft selbst einen tiefgreifenden Wandel. Willkommen im Zeitalter der leistungsstarken KI-Netzwerke.

Warum benötigt KI spezialisierte Netzwerke?

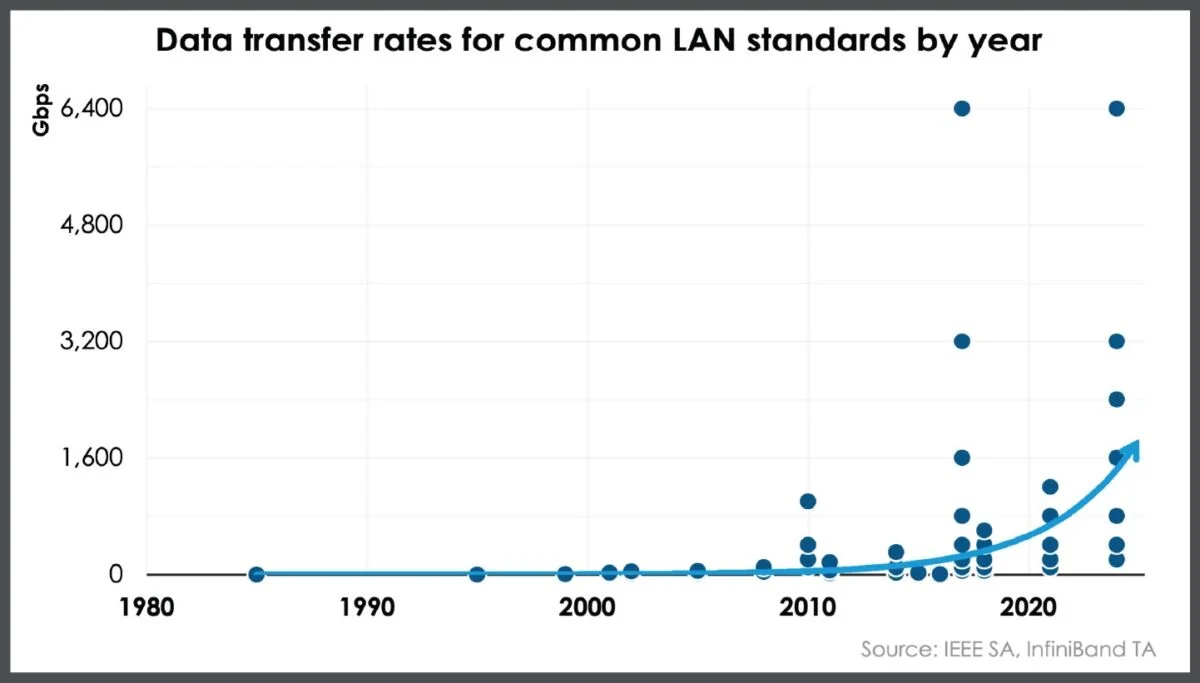

GPUs sind sehr teuer, insbesondere in den Mengen, die für große KI-Workloads benötigt werden. Hochleistungsfähige Supercomputer-Plattformen im Rack-Format mit über 70 GPUs erfordern Investitionen in Millionenhöhe. Unternehmen und Cloud-Anbieter, die massiv in fortschrittliche Chipsätze investieren, wollen keine Netzwerkengpässe, die sie ausbremsen. Was früher für Geschäftsanwendungen mit Datenübertragungsraten von 25 Gigabit pro Sekunde (Gbit/s) ausreichend war, ist bei Geschwindigkeiten von fast 1.600 Gbit/s (1,6 Terabit pro Sekunde), wie sie beim KI-Training üblich sind, völlig unzureichend. Eine KI-Netzwerkinfrastruktur mit hoher Bandbreite und geringer Latenz ist daher unerlässlich.

Die Datenübertragungsraten in LANs sind im letzten Jahrzehnt exponentiell gestiegen, und für einige Standards werden im Jahr 2026 Geschwindigkeiten von bis zu 25,6 Tbit/s erwartet. Dies unterstreicht die Notwendigkeit für Rechenzentrumsbetreiber, sicherzustellen, dass sie die neuesten Technologien einsetzen, um ihre Standorte zukunftssicher zu machen.