人工智能网络拓扑:向上、向外和向内扩展

在计算节点之间进行人工智能数据传输时,减少网络瓶颈并非易事。人工智能网络面临三重挑战:机架内部的纵向扩展、机架间的横向扩展,以及在因空间或电力限制而需要分布式人工智能网络时,跨数据中心设施的扩展。.

在为实时人工智能推理工作负载设计低延迟网络时,需要了解哪些内容?

工程师必须权衡一系列参数,以优化人工智能网络架构、性能、可扩展性和成本,其中包括:

- 实际工作负载下每个GPU的带宽

- 网络架构如何处理同步的GPU流量峰值

- 跳转间的微秒级延迟预算

- Clos、FatTree 和 Dragonfly 等不同拓扑结构之间的性能差异

- 高速和不同距离下铜缆与光纤的局限性

- 共封装光学器件和硅光子学的成熟度

- 交换机部署的热效应和功耗影响

- 链路故障对主动模型训练的影响

- 超大规模环境下的操作系统行为和稳定性

- 光学组件公差和损耗预算

- 不同供应商之间的硅芯片切换权衡

- GPU 利用率相对于网络阻塞

- 密集型人工智能网络结构中的常见故障模式

- 海岸线带宽密度(沿组件边缘单位长度的数据传输容量)

- 能量效率(pJ/bit)

如何为人工智能工作负载提供高性能连接?

大量数据的快速、同步传输需要无拥塞的人工智能网络架构、低延迟的人工智能网络架构和自主运行。.

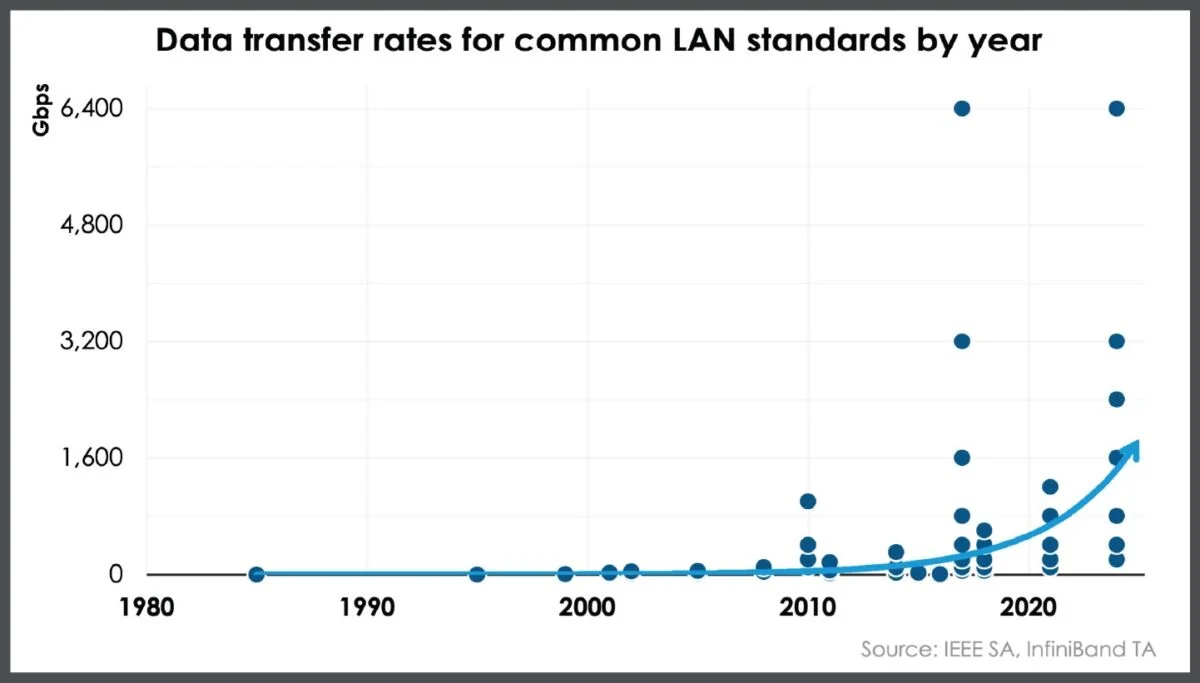

为大规模人工智能数据管道配置高吞吐量网络依赖于一系列人工智能网络技术的进步,其中包括:

- 计算织物

人工智能时代的计算要求网络架构必须无损且无拥塞,否则计算速度会变慢,GPU 也会闲置——这是一种浪费且成本高昂的状态——因为所有 GPU 都必须完成当前任务才能开始下一个任务。为了满足模型训练对带宽的巨大需求,能够提供高达 1.8 Tbps 带宽的网络架构正在涌现。工程师们需要权衡超低延迟和带宽、开放标准和互操作性、成本以及基础设施熟悉度等要求。.

- 数据处理

智能网络接口卡 (SmartNIC) 和数据处理单元 (DPU) 的出现,使得 CPU 可以将更多计算资源用于应用程序处理,从而减轻 CPU 的复杂任务负担。这些可编程网络适配器拥有独立的处理单元,能够处理存储、安全和数据管理等多种工作负载。.

- 光接口

随着人工智能网络带宽需求的日益增长,传统收发器会降低数据在处理硬件间传输的速度。将光器件集成到更靠近GPU的位置可以加快数据传输速度,从而降低延迟。诸如共封装光学器件、线性可插拔光学器件和硅光子学等创新技术不仅提高了性能,还降低了功耗,而功耗正是人工智能数据中心运营商最为关注的问题。.

- 开关

为了支持人工智能工作负载,网络交换机必须能够以闪电般的速度在连接点之间传输海量数据,而且这种传输往往以突发性强、足以使传统网络交换机不堪重负的方式进行。采用智能交换机的人工智能网络拓扑结构,能够使流量在人工智能加速器芯片之间持续传输,并借助先进的拥塞控制和自适应路由等创新技术,处理海量信息流而不会出现拥塞或数据丢失。此外,它们还集成了智能电源管理功能,以降低能耗并提高GPU的利用率。.

- 液冷

GPU并非人工智能数据中心中唯一耗电发热的硬件。与空气冷却系统相比,它能够更高效地散热,, 液冷冷板 同时还要管理 AI 网络架构交换机 ASIC 的过热问题。.

- 开源软件

供应商锁定是数据中心运营商关注的问题。面向云的开放网络软件 (SONiC) 是一款开源网络操作系统,它使企业能够在来自不同交换机供应商的各种设备上使用相同的网络软件堆栈,从而提高灵活性、可扩展性和模块化程度。.

如何大规模生产复杂的AI网络技术?

从制造角度来看,关键在于数据中心运营商必须做出选择。 与拥有工程技术专长、生产能力和弹性供应链的合作伙伴 大规模交付复杂、高质量的人工智能网络组件。当空前的需求遇到技术复杂性,且对性能问题零容忍时,明智的选择至关重要。.

寻找具备以下特质的合作伙伴: