介绍

本文探讨了人工智能数据中心液冷技术的必要性和优势,重点关注高功率人工智能服务器面临的挑战以及垂直电源模块(VPM)系统的优势。文章涵盖了不同的冷却方法、冷却方法的实际比较以及对相关DC/DC转换器的影响。.

当某个市场呈爆炸式增长时,例如人工智能服务器市场,其潜在规模难以预测。尽管如此,分析机构‘Research and Markets’估计,到2029年,该细分市场的价值将增长四倍,超过10亿美元至35万亿美元。 [1]. 尽管目前面向人工智能应用的服务器仅占数据中心市场总量的 10-15%,但它们却非常耗电。用于人工智能服务器的最新 GPU,例如 Nvidia GB200(由两块 Blackwell GPU 和一块 Grace CPU 组成),持续功耗超过 1kW,峰值功耗超过 2.5kW。这相比上一代 Nvidia Core H100 GPU 有了显著提升,后者功耗高达 700W,处理性能仅为 20%。.

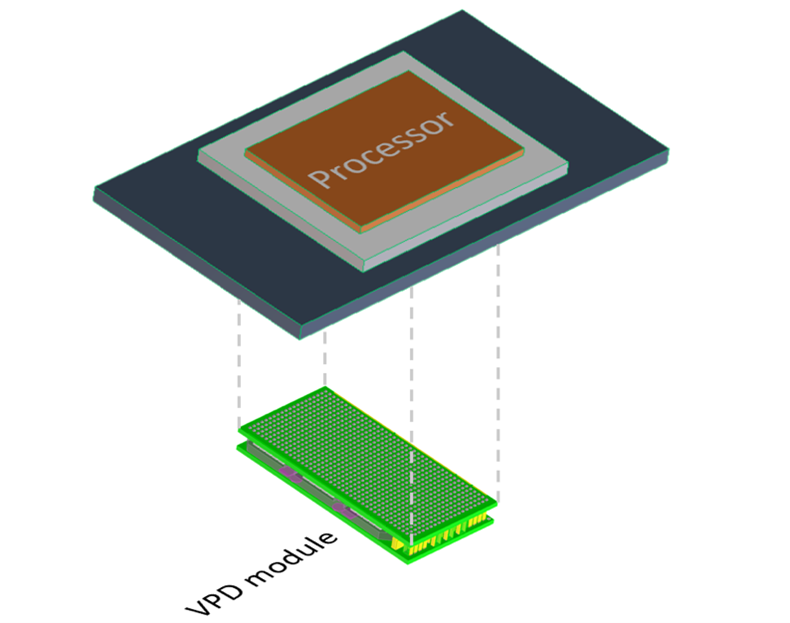

处理器需要通过 DC/DC 转换器提供本地电源轨,这些转换器需要尽可能靠近处理器放置,以避免连接处的静态和动态电压降。然而,在 AI 服务器中,由于功耗较高,将转换器横向放置在处理器周围不仅距离不够近,而且还会阻碍信号路由。一种由 DC/DC 转换器制造商(例如 Flex 电源模块)开发的相对较新的方法应运而生。 [2] 垂直电源模块 (VPM) DC/DC 转换器位于 PCB 底面处理器正下方(图 1)。现在,多通道 DC/DC 转换器处于最佳电气位置,能够以最小的 PDN(电源传输网络)损耗传输电力。.

图 1:处理器垂直供电

实际上,VPM 的设计是针对特定的处理器和服务器配置,因为其引脚排列必须与处理器匹配,以便于 PCB 走线。为了获得最佳性能,VPM 应纳入热建模,理想情况下,应使用其冷板在 PCB 底部进行液冷。VPM 器件的低矮外形和较大的表面积,在机械结构上与通过冷板对处理器进行‘芯片级’液冷非常契合,这种液冷方式适用于 AI 服务器的功率级别。相比之下,传统的 DC/DC 电源通常采用横向布局,其设计目标是尽可能缩小占地面积并采用强制风冷。所有这些都意味着,VPM 将在系统规格制定的早期阶段就被考虑在内,并可以纳入冷板冷却方案的设计中。.

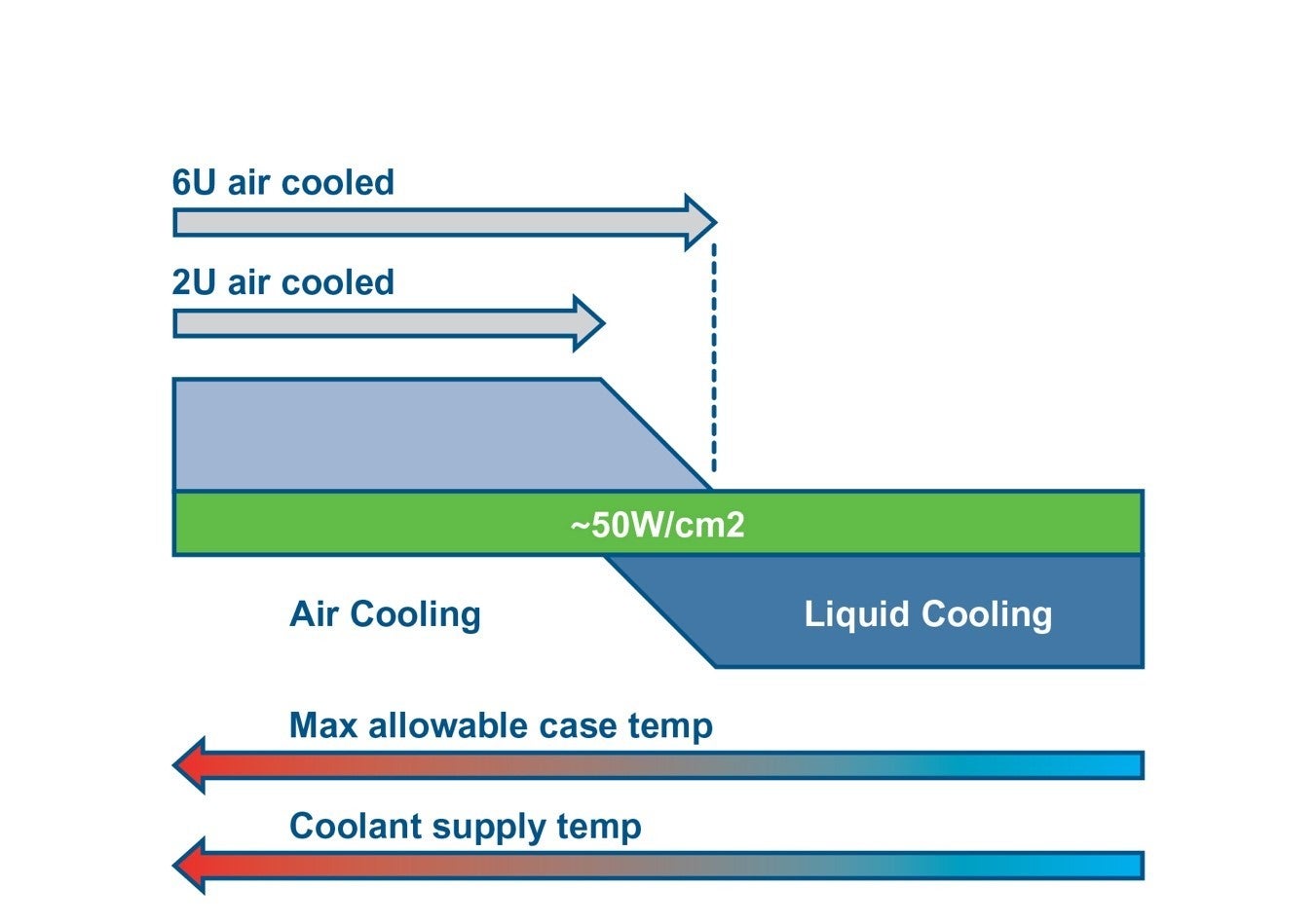

可以通过处理器占地面积每平方厘米的功耗来衡量液冷与对流冷却的必要性,大约为 50W/cm²。2 建议的断点取决于机架尺寸(图 2在较低功率密度下,强制风冷一直是主流散热方式,但鳍片式散热器体积较大,排气侧的热空气可能会吹到其他组件上,从而对可靠性产生不利影响。如果将处理器和散热器放置在服务器刀片机箱内靠近排气口的位置,则可以缓解这个问题,但这会对电路板设计造成不利限制。.

图 2:芯片在功率密度超过约 50W/cm² 时需要液冷。2 耗散

因此,液冷在任何功率级别下都是一项技术优势,但它并非简单的‘即插即用’升级。一个最佳的系统需要从头开始设计,并且还要考虑其他发热组件,例如为本地电源轨供电的DC/DC转换器。.

冷却方法

那么,液冷究竟有哪些优势呢?其优点包括更高的热能传输效率,从而可以缩小体积、降低系统能耗并减少运行成本。液冷还省去了负载附近一些噪音大且相对不可靠的风扇,尽管仍然需要一个集中式热交换器来排出液体中的热量。这通常通过强制空气冷却的方式实现,将热量排放到环境中或另一个管道水循环系统中,例如,该循环系统可用于社区供暖。液冷的缺点是安装成本较高,因此投资回报周期较长,并且由于液冷系统比独立的服务器风扇更加集中,因此在发生故障时系统可用性可能会降低。.

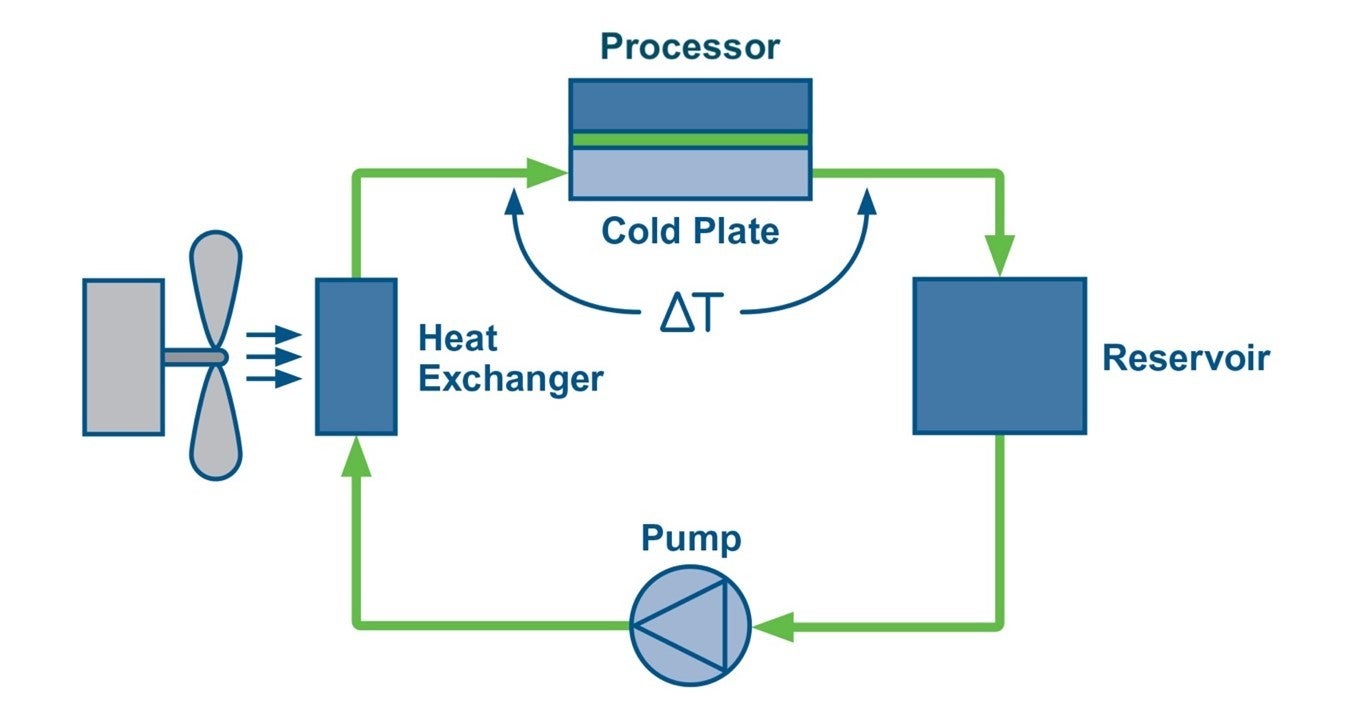

图中所示为一种闭环‘混合式’液冷装置。 图 3,, 处理器产生的热量通过冷板传递到带有水通道的冷却板上。这种冷却方式称为芯片直接冷却,冷却板的尺寸通常与被冷却器件的尺寸相同。实际上,它只需要足够厚以容纳水通道即可。这是一种‘单相’冷却方式,冷却剂(通常是水)被密封并持续保持液态。与强制风冷相比,这种技术显著提高了散热能力,我们将在后面进行量化分析。此外,如果使用导热系数高约 10 倍的氟碳基液体,则可以获得进一步的提升。另外,如果将液体加热到约 50°C 的沸点,在两相冷却系统中,通常使用的氟碳化合物的蒸发潜热可以使单位体积液体的吸热量比单相冷却系统高约 100 倍。另一个优点是,如果发生泄漏,介电冷却剂对组件的损害远小于水,但两相冷却系统的实施成本相对较高。实际上,处理器和冷板之间的导热界面材料成为一个限制因素,使得单相布置总体上成为一个不错的解决方案。.

图 3:示意图展示了一种单相水基芯片直接冷却系统,该系统带有液-气热交换器。

浸没式冷却也是一种可行的方案,即将整个电子系统浸入盛有介电液体的开放式冷却槽中。这种方法非常有效,冷却液循环至热交换器(例如冷却塔)。然而,由于环境问题、泄漏的可能性以及冷却系统可能成为整个机架的单点故障等原因,人们对浸没式冷却持谨慎态度,这是可以理解的。所用液体不导电,但其介电常数通常约为空气的两倍,这会使液体的杂散电容增加一倍,并可能影响高频信号线。该系统可以是单相或两相的。.

实际比较

空气冷却和液体冷却相对性能的主要指标是比热容,有时也称为热容量。比热容是指在一秒钟内将1千克介质加热1摄氏度所需的能量。水的比热容为4.2千焦/千克,空气的比热容为1.0千焦/千克。1千克空气的体积约为0.85立方米。3 1公斤水约等于1升或0.001立方米3 因此,要‘转移’相同量的热量,所需的空气体积是水的 3600 倍。.

为了比较不同散热方法的相对性能,假设一个处理器功耗为 1kW (Q),表面温度上限为 80°C,环境温度最高为 50°C,且风速为 5m/s。该处理器需要的散热器体积 V 约为 2700cm³。3, 从这种简单的关系出发: V=(QR五)/ΔT [3]. 假设 5 米/秒的气流速度会使散热器的体积热阻 (RV) 为 80 厘米。3 °C/W。.

这种尺寸的散热器(约14厘米立方体)显然不切实际。虽然可以缩小尺寸,但这会增加硬件和能源成本,因为需要降低环境温度或允许处理器温度升高,而处理器温度升高又会导致可靠性问题,因为芯片温度会更高。产生的热量会吹过其他组件,并排放到服务器机架,然后由数据中心的空调系统对空气进行冷却。另一个限制是,假设进气口到出气口的空气温升为20°C,且散热功率为1kW,则需要约40升/秒的空气流量,而以5米/秒的速度流动,则空气通道的最小面积需要约为8平方厘米。2 必须通过服务器刀片机箱进行维护。.

相比之下,在液冷系统中,冷板对液体的热阻可以低至 0.01°C/W。假设没有其他散热途径,对于 1kW 的功率和 80°C 的芯片表面温度限制,水温不应超过 70°C。例如,对于 25°C 的进水温度,我们可以根据以下公式计算所需的水质量流量 (MFR): MFR = Q/ΔT.c [4], 其中 c 为水的比热容 (4.2 kJ/kg°C)。由此计算得出 MFR 为 0.005 kg/秒或 5 cm3每秒,也就是通过直径为 1 厘米的管道的流速只有大约 6.4 厘米/秒,这很容易实现。.

热水流经热交换器(通常是翅片式散热器),但由于冷却液管道可以均匀分布,因此热交换器可以相对较小且效率较高,这与处理器散热器不同,处理器散热器的热源集中在一个小区域内。.

结论

鉴于最新人工智能处理器功耗巨大,液冷已成为必需。处理器耗散的千瓦数也会影响相关DC/DC转换器的布局和散热,这些都应纳入整体散热设计中。.

(首次发表于 电力电子新闻)

参考

[1] https://www.researchandmarkets.com/report/artificial-intelligence-server

[2] https://flexpowermodules.com

[3] https://celsiainc.com/resource…

[4] Simons, R.,《水-空气混合冷却系统中的温度估算》,电子冷却,2002 年 5 月