Las empresas reconocen la IA como un diferenciador competitivo y proliferan los casos de uso. Las potentes GPU han cautivado la imaginación y han captado la atención de los consumidores en la carrera por procesar cantidades extraordinarias de datos con mayor rapidez. La tecnología es sensacional, pero ¿qué hay del resto del hardware que hace posible la computación con IA?

Si la informática es el cerebro del mundo digital, la red es el sistema nervioso central, y está experimentando una importante transformación propia. Bienvenido a la era de las redes de IA de alto rendimiento.

¿Por qué la IA requiere redes especializadas?

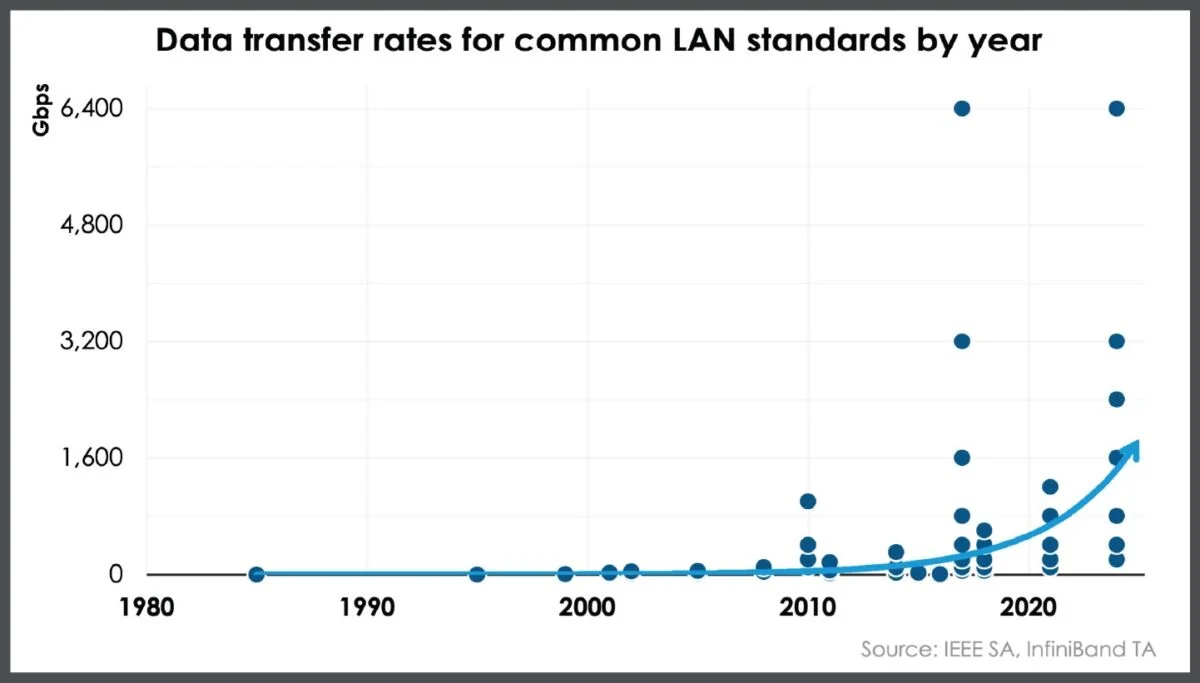

Las GPU son muy caras, especialmente en las cantidades necesarias para grandes cargas de trabajo de IA. Las plataformas de supercomputación de alto rendimiento a escala de rack con más de 70 GPU integradas generan millones en gastos de capital. Las empresas y los proveedores de la nube que invierten fuertemente en chipsets avanzados no quieren que los cuellos de botella de la red los ralenticen. Lo que antes era adecuado para datos de aplicaciones empresariales que viajaban a 25 gigabits por segundo (Gbps) resulta lamentablemente insuficiente a velocidades cercanas a los 1600 Gbps (1,6 terabits por segundo), como es habitual durante el entrenamiento de IA. Una infraestructura de red de IA de alto ancho de banda y baja latencia es innegociable.

Las tasas de transferencia de datos LAN han crecido exponencialmente durante la última década, y se espera que algunos estándares alcancen velocidades de hasta 25,6 Tbps en 2026, lo que refuerza la necesidad de que los operadores de centros de datos se aseguren de utilizar las últimas tecnologías para preparar sus sitios para el futuro.