Como seguramente ya sabrá, la "nube" describe el conjunto de código que se ejecuta en ordenadores de centros de datos y granjas de servidores. Ya sean consumidores que almacenan sus fotos en iCloud o Google Drive, o empresas que gestionan sus sistemas alojados, alguien tiene que administrar el centro de datos que presta el servicio. Pero, ¿qué implica el auge actual de la computación en la nube para los subsistemas de suministro y conversión de energía en todos esos centros de datos?

La demanda de energía va en aumento.

Según Gartner, la computación en la nube se ha convertido en la "nueva normalidad", y la pandemia de COVID-19 le ha dado un impulso adicional. Se espera que el gasto de las empresas usuarias finales en servicios de nube pública alcance los 1.350.304 millones de dólares en 2021.[1]. IDC cita cifras similares, con una tasa de crecimiento anual de 24 %. Los centros de datos que brindan estos servicios suelen operar las 24 horas del día, los 7 días de la semana, y los usuarios esperan que estén disponibles constantemente, sin importar la hora del día.

Al mismo tiempo, las amenazas a la seguridad siguen aumentando, lo que implica una mayor necesidad de protección proactiva y permanente, así como una mayor demanda de copias de seguridad disponibles rápidamente. El uso de software antivirus y de protección contra amenazas, junto con el cifrado y el descifrado, incrementan la carga de los servidores.

Para los grandes proveedores como Amazon Web Services y Microsoft, minimizar el tiempo de inactividad es una ventaja competitiva clave. En la práctica, esto a menudo significa operar dos centros de datos en una configuración "activo-activo", con los sistemas de respaldo listos para entrar en funcionamiento de inmediato si hay algún problema en el sitio principal, o incluso pasar a una topología de tres centros de datos.[2].

El rendimiento de los servidores y el almacenamiento en los centros de datos está aumentando, y existe una demanda de sistemas más compactos que reduzcan el espacio necesario y, por lo tanto, el coste. Esta tendencia hacia sistemas de TI más pequeños y densos implica que los sistemas de alimentación también deben ser lo más compactos posible, a la vez que se maximiza la eficiencia para mantener bajos los costes de energía y refrigeración.

De hecho, el consumo energético total de los centros de datos se ha mantenido prácticamente constante en los últimos años, ya que las mejoras en la eficiencia han compensado los aumentos de rendimiento. Por ejemplo, la virtualización ha permitido una utilización mucho más eficaz de la CPU, la memoria y el almacenamiento, y un menor desperdicio de energía en equipos infrautilizados. Si bien algunas estimaciones indican que los centros de datos consumen hasta 12 % de la electricidad del Reino Unido.[3], La cifra global suele situarse entre 1 y 2 %, con un problema igualmente enorme en términos de CO.2 emisiones.

Figura 1: Racks modernos para centros de datos

Arquitecturas de sistemas de energía

Hemos constatado que es necesario que los sistemas de energía proporcionen una mayor potencia de salida, minimizando al mismo tiempo el espacio físico que ocupan y aumentando su eficiencia.

Los proveedores de sistemas de alimentación han adoptado diversos enfoques para satisfacer estas demandas. Las arquitecturas tradicionales de alimentación de centros de datos proporcionaban una fuente de alimentación de CA individual a cada servidor en un rack, donde se convertía localmente para cada carga. En cambio, una tendencia emergente consiste en gestionar la conversión de CA a CC de forma masiva, quizás con un solo sistema convertidor por rack. La corriente continua resultante se distribuye posteriormente a cada servidor.

Con el aumento en los requerimientos de energía total de los racks, también se observa una tendencia a pasar de la distribución de 12 V CC a la de 48 V CC. Al cuadruplicar el voltaje, se puede reducir la corriente necesaria para suministrar la misma cantidad de energía, disminuyendo las pérdidas en un factor de 16 y evitando la necesidad de cables de alimentación grandes y costosos.

La alimentación de 48 V CC a una placa se suele convertir primero a 12 V mediante un convertidor de bus intermedio (IBC) y, posteriormente, mediante un convertidor de punto de carga (PoL) local, a la baja tensión requerida por los componentes específicos. Esta arquitectura de dos etapas proporciona una alta eficiencia y puede suministrar altas corrientes si es necesario, o bien, en un sistema económico, proporcionar bajas corrientes.

Otro método, denominado conversión directa, utiliza una sola etapa para convertir la tensión de alimentación de 48 V directamente a la baja tensión requerida por la carga, que puede ser de 2 V o menos. Al mantener la alimentación a la tensión más alta de 48 V hasta la carga, esto puede ser útil cuando se requiere una corriente elevada, por ejemplo, para procesadores de gama alta, ASIC y FPGA. Ya sean de dos etapas o de conversión directa, los convertidores CC-CC actuales suelen incluir un control digital sofisticado, por ejemplo, mediante el bus PMBus, estándar en la industria.

Nuevos dispositivos de potencia en la práctica

Veamos un ejemplo de dispositivo: el BMR492 de los módulos de potencia Flex. Este es un convertidor CC/CC de alta potencia diseñado para aplicaciones de centros de datos, que proporciona una salida de 12 V a partir de una tensión de entrada nominal de 48 V. Puede proporcionar una salida máxima de hasta 1100 W durante períodos cortos de hasta un segundo, lo que lo hace muy adecuado para las demandas de potencia en "modo ráfaga" de las CPU modernas, además de lograr una alta eficiencia de hasta el 97,4 % %.

Si bien estas cifras son impresionantes, el avance clave del BMR492 radica en ofrecer tales resultados en un formato compacto. De hecho, utiliza el formato estándar de la industria de "octavo ladrillo" (con unas dimensiones de tan solo 58,4 x 22,7 x 13,2 mm) y proporciona una potencia y un rendimiento que antes solo eran posibles en dispositivos más grandes de tamaño cuarto de ladrillo.

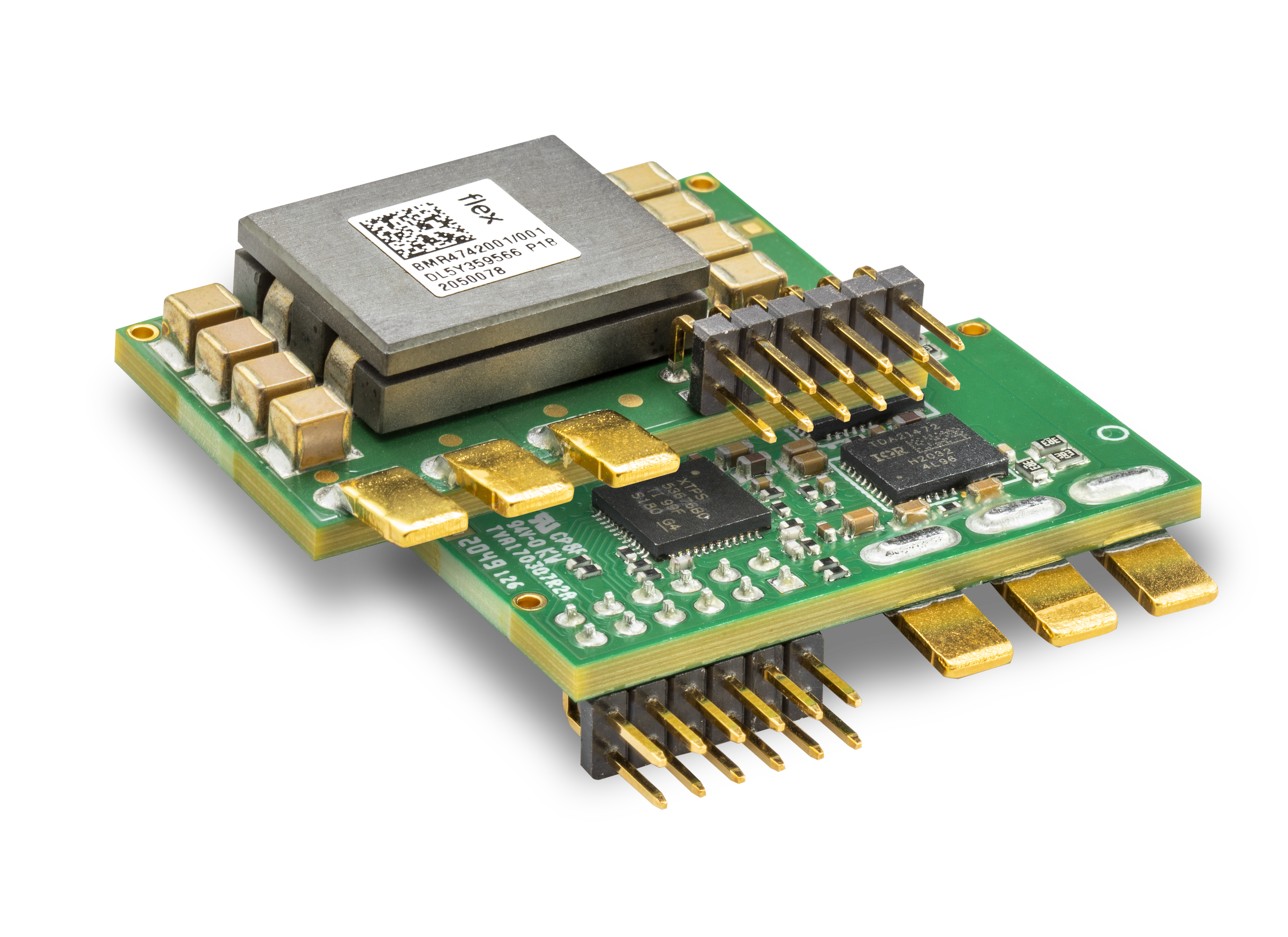

Figura 2: BMR474

Un enfoque para el punto de carga (PoL) descendente es utilizar un formato SIP (paquete en línea único) compacto y montado verticalmente, que minimiza el espacio ocupado en la placa. Por ejemplo, el BMR474 El módulo Flex Power Modules es un convertidor CC/CC PoL digital que proporciona una salida de entre 0,6 V y 3,3 V, tomada de una entrada en el rango de 6 V a 15 V. La eficiencia es del 95,1 % (%) a plena carga, con un voltaje de entrada de 12 V y una salida de 3,3 V.

Gracias a su diseño de montaje vertical SIP, el BMR474 tiene una huella reducida de tan solo 2,84 cm.2, De esta forma, ocupa un espacio mínimo en la placa. Aun así, puede suministrar hasta 80 A de corriente de salida para satisfacer las necesidades de las cargas típicas de un centro de datos.

Figura 3: Capturas de pantalla de ejemplo de Flex Power Designer

Además de sus excelentes especificaciones eléctricas, los BMR492 y BMR474 ofrecen un comportamiento térmico superior, con opciones de refrigeración por conducción o convección, así como una sólida protección contra sobretemperatura. Los ingenieros de diseño pueden optimizar tanto el rendimiento eléctrico como el térmico mediante el uso de Diseñador de potencia Flex (FPD), una herramienta de software gratuita.

Conclusión

El rendimiento de los centros de datos está aumentando, pero al mismo tiempo, los sistemas se están volviendo más compactos, mientras que la demanda de disponibilidad ininterrumpida (24/7) y las crecientes amenazas a la seguridad plantean desafíos. Paralelamente, se observa una presión a la baja sobre el consumo de electricidad.

Para los ingenieros de diseño de sistemas de energía, esto puede parecer, en un principio, una hazaña inalcanzable. Pero las nuevas arquitecturas y componentes están aquí para ayudar a resolver los desafíos de diseño, garantizando que se pueda satisfacer nuestra creciente demanda de servicios en la nube.